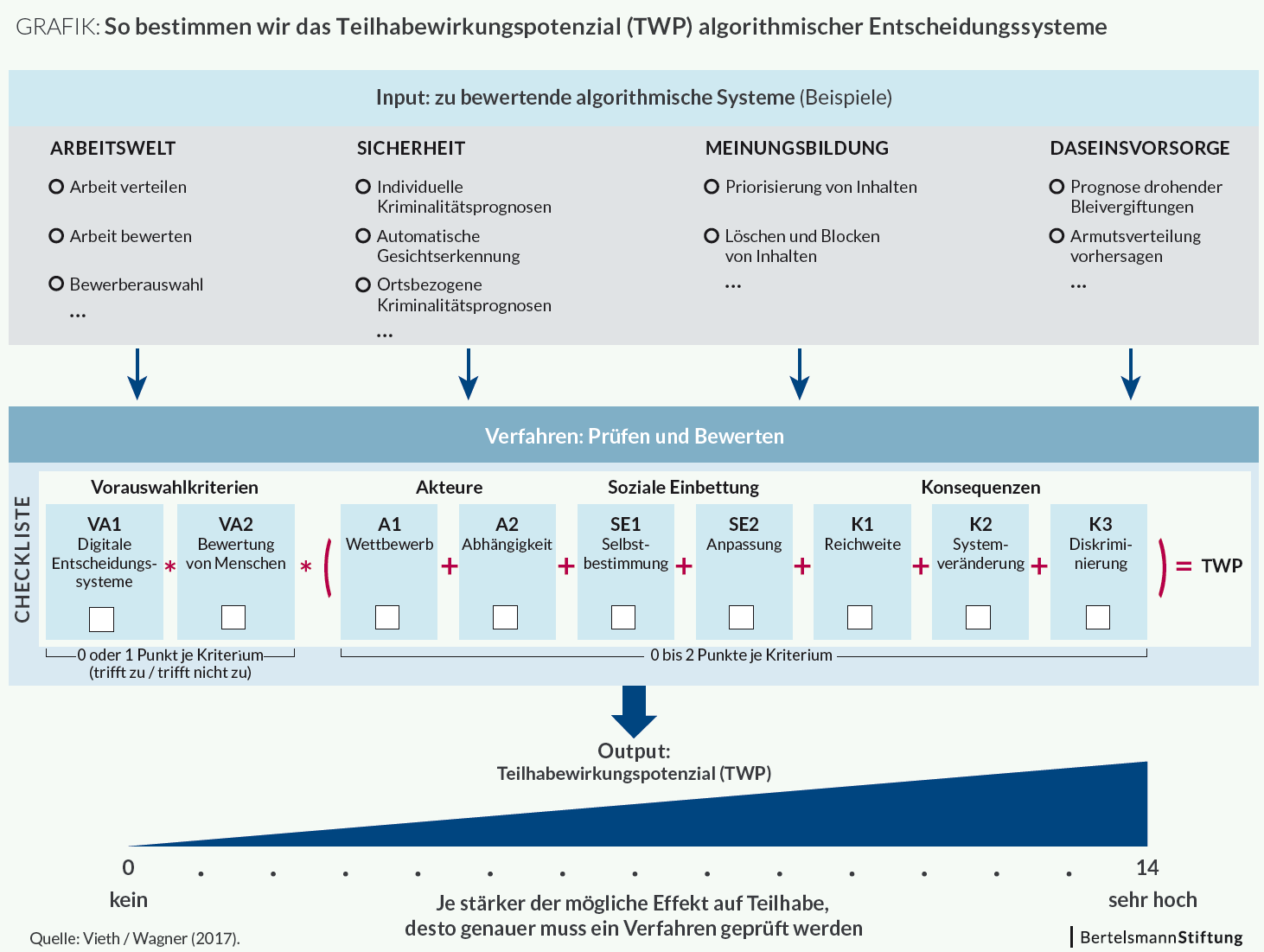

Kriminalitätsprognosen, Kreditvergabe, Bewerberauswahl: Algorithmische Systeme beeinflussen heute auf unterschiedlichen Gebieten die Leben vieler Menschen. Das wirft neue Fragen im Hinblick auf Teilhabe auf. Wie viel Beeinflussung durch Algorithmen ist für jeden Einzelnen und für die Gesellschaft als ganze verträglich und förderlich?

Wir haben einen Vorschlag zur Klassifizierung von Prozessen algorithmischer Entscheidungsfindung entwickelt. Dieser soll helfen, die potenzielle Wirkung von algorithmischen Verfahren auf Teilhabe anhand weniger Kriterien zu bewerten und vergleichbar zu machen. Damit können zum Beispiel tiefergehende Untersuchungen priorisiert und vorbereitet werden.

Die Bewertung der Teilhabewirkung, für die wir hier einen Strukturierungsvorschlag machen, bietet eine Grundlage für weitere Schritte, seien es eingehendere Analysen oder Maßnahmen zur Regulierung. Wenn eine hohe potenzielle Wirkung auf Teilhabe zu erwarten ist, muss konsequent dafür gesorgt werden, dass die positiven Effekte ausgeschöpft werden, und negative Effekte, etwa Diskriminierung durch algorithmische Prozesse, verhindert werden. Gerade bei großer Teilhabewirkung von Algorithmen geht es deshalb oft darum, Vielfalt, fairen Wettbewerb und rechtsstaatliche Grundsätze abzusichern. Je höher der Anspruch an teilhaberelevante algorithmische Entscheidungsprozesse, desto umfangreicher sind die potenziellen Maßnahmen, die in Frage kommen.

Methodischer Ansatz

Um die potenzielle Wirkung auf Teilhabe zu klassifizieren, kann es kein binäres Entscheidungskriterium geben. Das würde die vielen sozial konstruierten Logiken ignorieren, die in Prozessen algorithmischer Entscheidungsfindung eingebettet sind.

Eine Vielzahl von Kriterien können Auswirkungen auf die Teilhaberelevanz haben. Die Auswahl und Gewichtung dieser Kriterien hängt dabei auch von der jeweiligen Teilhabedefinition ab. Es geht nicht um eine Bewertung guter oder schlechter Verfahren algorithmischer Entscheidungsfindung, sondern um eine relative Beurteilung ihres potenziellen Wirkungsgrads auf Teilhabe, gleich in welcher Richtung.

Die Kriterien gliedern sich in drei Gruppen: Akteure, soziale Einbettung und Konsequenzen. Sie orientieren sich also nicht an technologischen Gegebenheiten, sondern versuchen, politische und soziale Konstellationen zu erfassen.

Die Akteurskriterien untersuchen die effektive ökonomische und politische Macht hinter den Betreiberinnen der Entscheidungsprozesse. Bei den Prüfkriterien zur sozialen Einbettung geht es darum, die beabsichtigten und unbeabsichtigten gesellschaftlichen Wechselwirkungen zu bedenken. Schließlich werden die möglichen oder bereits real erkennbaren Konsequenzen in Bezug auf politische und soziale Grundrechte analysiert. Als inhaltliche Richtschnur für die Bewertung der Konsequenzen für Teilhabe ziehen wir hier rechtliche Normen heran. Als Basis dient der Anwendungsbereich des Allgemeinen Gleichstellungsgesetzes (§ 1 und 2 AGG). Demnach ist Benachteiligung insbesondere dort unzulässig, wo es um den Zugang zur Erwerbsarbeit, die Arbeitsbedingungen, die Mitgliedschaft in Gewerkschaften und die Berufsausbildung geht. Auch den fairen Zugang zur Versorgung mit öffentlichen Gütern wie Bildung, soziale Absicherung, Gesundheitsschutz oder Wohnraum gilt es sicherzustellen.

Wir schlagen vor, erst ab einer bestimmten Grundschwelle von Teilhabewirkung auszugehen. Mit Hilfe der nachfolgend skizzierten Kriterien kann die relative Teilhabewirkung überblicksartig erfasst und verglichen werden. Dies ermöglicht die Erstellung einer vereinfachten und handhabbaren Rangfolge von Algorithmen, um bei Bedarf weitere Schritte zu priorisieren.

Jedes der unten aufgeführten Prüfkriterien kann das Teilhabewirkungspotenzial (TWP) erhöhen (TWP=+1). Wenn ein Kriterium nicht zutrifft bzw. sich im Schnellverfahren nicht bewerten lässt, wird kein Teilhabewirkungspunkt vergeben (TWPneutral=0). Pro Kriterium können auch halbe Punkte (TWP=+0.5) vergeben werden, jedoch nicht mehr als zwei (TWPmax=+2). Das Gesamtspektrum reich also von null bis zwei Punkten pro Kriterium. Je höher der Gesamtwert, desto größer die potenzielle Wirkung des Verfahrens auf Teilhabe.

Die Kriterien sind mit beispielartigen Testfragen hinterlegt. Die Beantwortung dieser Fragen fällt nicht immer leicht. Doch gerade weil die Anwendungsfälle so vielfältig und mitunter unübersichtlich sind, liegt hier der Mehrwert der abstrakten Klassifizierung: Sie reduziert Komplexität in einem von hoher Komplexität geprägten Themenfeld. Was kann Teilhabe einschränken oder stärken? Eine Organisation oder Person analysiert entlang der Prüfstruktur einen oder mehrere entsprechenden Prozess. Nach Anwendung der Kriterien auf den Einzelfall kann sie anhand des Ergebnisses einschätzen, welche Aspekte des Entscheidungsprozesses hervorstechen und verschiedene Verfahren miteinander vergleichen.

Akteure

A1 Wettbewerb: Wer ist der Betreiber des Algorithmus? Wie viel politische und ökonomische Macht hat er? Besteht effektiver Wettbewerb zwischen mehreren Betreibern (Oligopole, Monopole, Kartelle, marktbeherrschende Stellung, hoheitliche Macht)?

Beispiel Grenzkontrollen: Auch wenn private Firmen die Software für Visabewertungen produzieren und/oder betreiben, wird sie im Rahmen hoheitlicher Machtausübung angewendet. Der staatlichen Macht bei der Visavergebe kann sich niemand entziehen, insofern würde auch der private Betreiber mit staatlichem Auftrag als Monopol gewertet. Die reine Rechtsform des Betreibers ist also weniger relevant für die Wirkung auf Teilhabe.

A2 Abhängigkeit: Ist es ein Problem, wenn der Prozess bzw. das produzierte Gut wegfällt oder der Zugang dazu verwehrt wird? Kann das Gut unmittelbar ersetzt werden? Gibt es alternative Verfahren/Angebote? Wie hoch sind die Kosten, auf ein alternatives Verfahren umzusteigen? Welche Organisationen oder Personengruppen sind strukturell abhängig von dem Verfahren? Erzeugen Aufbau und Funktionsweise des Systems eine informelle Abhängigkeit? Welche technischen oder sozialen Lock-in-Effekte gibt es?

Beispiel Crowdwork: Auf dem Markt für Crowdworking-Plattformen herrscht Wettbewerb. Mehrere Plattformanbieter konkurrieren sowohl um Auftraggeberinnen als auch Crowdworkerinnen. Eine Abhängigkeit der Beschäftigten könnte trotzdem entstehen, wenn die Auftragshistorie und Reputation an die spezifischen algorithmischen Bewertungsverfahren der Plattform gekoppelt sind. Ein ähnlicher „Lock-in-Effekt“ kann etwa auch bei anderen Bewertungssystemen oder sozialen Medien auftreten.

Soziale Einbettung

SE1 Selbstbestimmung: Inwiefern dient das Verfahren (nur) zur Vorbereitung einer Entscheidung? Bleibt die Nutzerin selbstbestimmt? Entscheidet das System (de facto oder offiziell) selbständig? Wie viel Freiraum zur Änderung und Kontrolle einer algorithmischen Entscheidung hat die Anwenderin? Wie wirken sich Zeitdruck und operative Verwendung des Verfahrens auf die Selbstbestimmung der Anwenderinnen aus?

Beispiel Inhaltskontrolle: Wie die Software zur Kontrolle von potenziell rechtswidrigen Inhalten gestaltet ist, kann großen Einfluss auf die Eigenständigkeit der Anwenderin haben. Durch Zeitdruck, (z.B. hohe Taktung) und technische Einschränkung, kann der Spielraum für menschliche Abwägungen de facto stark reduziert sein, auch wenn offiziell ein Mensch die finale Entscheidung trifft.

SE2 Anpassung: Wie passen sich Menschen an den Prozess an? Wie wirkt das Entscheidungssystem in der Praxis? Welche Wechselwirkungen zwischen Mensch und Computer verändern unter Umständen das Ergebnis? Welche effektive, soziale Autorität hat das algorithmische Verfahren? Welche (soziale) Bedeutung wird dem Prozess zugeschrieben? Hat er Diskurshoheit? Wie viel Macht steckt in den Ergebnissen des Prozesses?

Beispiel Trending Topics: Die sogenannten „Trending Topics“ auf Twitter werden nicht selten als soziale „Realität“ angesehen. Obwohl nicht bekannt ist, wie das Ranking zustande kommt, hat es Einfluss auf den Diskurs und unterschiedliche Akteure passen sich an die Logik des Trending-Topics-Algorithmus an.

Konsequenzen

K1 Reichweite: Wie viele Personen sind von dem Entscheidungsprozess betroffen (z.B. Nutzerzahlen)? Ist die Reichweite des Verfahrens bekannt bzw. begrenzbar? Wie groß ist sie?

Beispiel Bewerberauswahl: Wenn nur ein Unternehmen eine Software zur Auswahl von Bewerberinnen einsetzt, ist die Reichweite relativ gering. Wird sie jedoch als ein zentrales Entscheidungssystem in vielen Unternehmen eingesetzt, steigt die Teilhabewirkung. Etwa wenn die Entscheidungslogik eines Systems in einer bestimmten Region oder Branche die Personalauswahl dominiert.

K2 Systemveränderung: Hebelt der Entscheidungsprozess solidarische Prinzipien aus? Ist eine Individualisierung systemverändernd? Hat das Verfahren eine potenzielle, eventuell nicht beabsichtigte, Transformation des (sozialen) Wirkungsumfelds zur Folge?

Beispiel Krankenkasse: Wenn die Kosten für öffentliche Krankenversicherung durch Algorithmen mitentschieden und nach einer neuen Logik individualisiert werden, dann wird ein bisher auf Solidarität beruhendes System verändert. Anstatt alle entsprechend ihrer Leistungsfähigkeit einzahlen zu lassen, werden mindestens Teile des Beitrags auf Basis individueller Faktoren berechnet.

K3 Diskriminierung: Wie stark könnten Menschen durch das Entscheidungsverfahren benachteiligt werden? Lässt sich für den Output ein diskriminierendes Muster, z.B. aufgrund von Rasse, Herkunft, Geschlechts, Religion oder Weltanschauung, körperlicher Beeinträchtigung, Alter oder sexueller Identität feststellen bzw. erwarten?

Beispiel automatisierte Stellenanzeigen: Eine Untersuchung von Googles Werbeanzeigen für Jobs zeigte, dass als Männer kategorisierte Nutzer eher hochbezahlte Stellen angezeigt werden als Frauen. Hier wirkt das Verfahren also auf die Teilhabe am Arbeitsmarkt.

So lässt sich Teilhabewirkungspotenzial bestimmen

Der Grad des Teilhabewirkungspotenzials (TWP) eines beliebigen, neuen Prozesses algorithmischer Entscheidungsfindung lässt sich daher in der Gesamtschau wie folgt darstellen:

TWP = VA1 * VA2 * ( A1 + A2 + SE1 + SE2 + K1 + K2 +K3 )

Algorithmische Entscheidungsprozesse sind für diese Expertise grundsätzlich relevant, wenn ein digitales Entscheidungssystem zum Einsatz kommt, und wenn Menschen oder ihnen zugeschriebene Eigenschaften dabei bewertet werden. Diese beiden Filterkriterien „Digitale Entscheidungssysteme“ (VA1) und „Bewertung von Menschen“ (VA2) können entweder den Wert 0 (nicht erfüllt) oder 1 (erfüllt) annehmen. Der Grad des Teilhabewirkungspotenzials (TWP) ergibt sich aus dem Produkt der beiden Vorauswahlkriterien und der Summe der Teilhabewirkungskriterien. Die Höhe des TWP-Werts ergibt aus der Summe der Prüfkriterien ( A1 + A2 + SE1 + SE2 + K1 + K2 +K3 ). Das Gesamtergebnis (TWP) besagt, wie stark sich ein algorithmischer Entscheidungsprozess auf die Realisierung von Teilhabe auswirken kann. Die Skala reicht von 0 bis 14. Mit der Prüfstruktur lassen sich Verfahren herausfiltern, die Teilhabe berühren, aber bei denen sich das Wirkungspotenzial in Grenzen hält. Dies könnte der Fall sein, wenn TWP kleiner als 3 ist, wobei man diese Schwelle der Teilhaberwirkung verschieben kann, je nachdem, wie sensibel man die eigene Teilhabedefinition auslegt.

Aus den obenstehenden Kriterien lässt sich ein schnelles und relativ einfaches Prüfverfahren entwickeln, in denen Unternehmen und Prüferinnen auf zwei bis drei Seiten ihre algorithmischen Entscheidungsverfahren nach bestimmten Kriterien durchchecken (zum Beispiel das „Quick Check Sheet“ des Danish Institute for Human Rights). Derartige Kriterien könnten Akteurinnen nutzen, um Prozesse algorithmischer Entscheidungsfindung auf Teilhaberelevanz zu prüfen. Insofern dient das Verfahren als schneller und einfacher Einstieg für das Verständnis eines algorithmischen Entscheidungsprozesses. Eine gründliche Prüfung kann es nicht ersetzen.

Veröffentlicht unter CC BY-SA 3.0 DE (Namensnennung — Weitergabe unter gleichen Bedingungen). Dies ist ein gekürzter Auszug aus dem Arbeitspapier “Teilhabe, ausgerechnet” 1. Auflage 2017 , 50 Seiten (PDF), DOI 10.11586/2017025

![reframe[Tech]](https://www.reframetech.de/wp-content/themes/child-reframetech/assets/images/logo.svg)

Kommentar schreiben